Sonagramme und Bild-KI

15. Juli 2025

Heute kann jeder mit dem Handy Fotos von Pflanzen oder Tieren erstellen und anhand dieser Fotos eine Bestimmung erhalten. Häufig mit relativ guten Ergebnissen, wenn denn die Fotoqualität gut ist. Ermöglicht wird dies durch bildgestützte künstliche Intelligenz. Das bedeutet, die KI wird mit bekannten Bildern trainiert und daraus resultiert ein Modell zur Bestimmung neuer Fotos. So werden aber auch für Vogelgesänge Sonagramme verwendet, um diese dann mit einer Bild-KI für die Artbestimmung zu nutzen. Beinahe jeder hat heute die eine oder andere solche App auf dem Smartphone und selbst zum Kartieren wird diese Technologie verwendet. Nun ist es naheliegend, den selben Weg auch für die Erkennung und Bestimmung von Fledermausrufen zu verwenden.

Sonagramme und Bild-KI

Was mit Vogelgesängen geht, muss ja mit Fledermaus-Rufen auch klappen. Die KI kann so etwas ja schon lange. Das bekommen wir so immer wieder gesagt und es gibt zahlreiche Wünsche in dieser Richtung. Denn die Bestimmung wird dann dank KI ja endlich korrekt. Und natürlich beschäftigen wir uns auch selber mit genau dieser Frage seit geraumer Zeit. So haben wir zum Beispiel bereits im Januar 2020 ein Beispiel-Projekt mit dem Namen CoreML-Bats hierzu kostenlos online gestellt. Ein erster Versuch mittels Sonagrammen Arten zu bestimmen. Anfangs hatten wir uns dazu auf die Gruppe Nyctaloid fokussiert. Später haben wir aber auch alle anderen Arten mit aufgenommen. Dabei haben wir den einen oder anderen Stolperstein kennen gelernt, der sich dann positiv oder - häufig - negativ auf die Bild-KI auswirkt. Das größte Problem für die KI ist, wie auch für die Bestimmung mit anderen Methoden, die Qualität der Aufnahme eines Rufs. Insbesondere sind Echos und andere Störungen äußerst nachteilig, da der Nutzgehalt eines Fledermaus-Ruf-Sonagramms sehr niedrig ist im Vergleich zu Fotos von Blütenpflanzen oder Sonagrammen von Vogelgesängen.

Sonagramme fürs Training

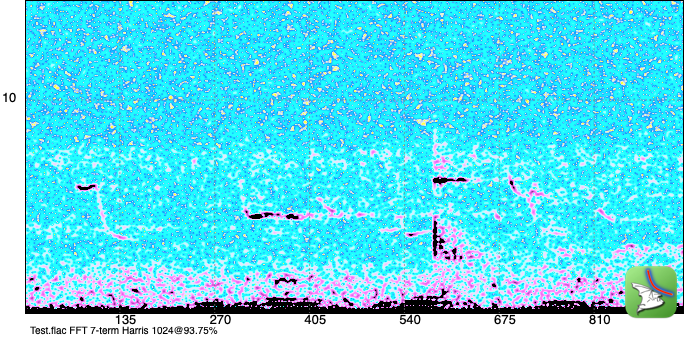

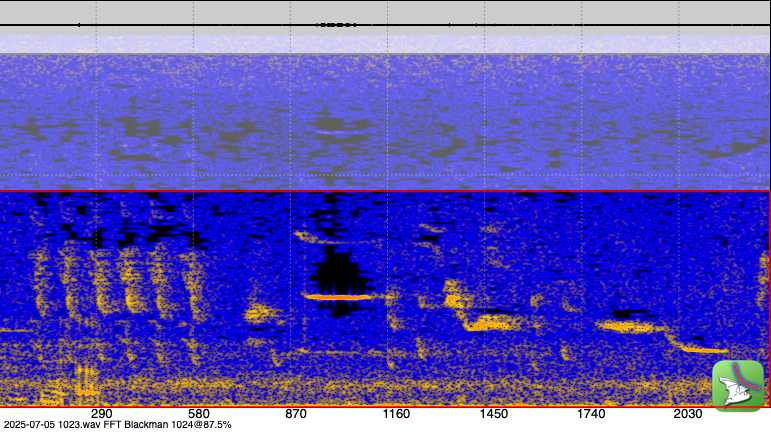

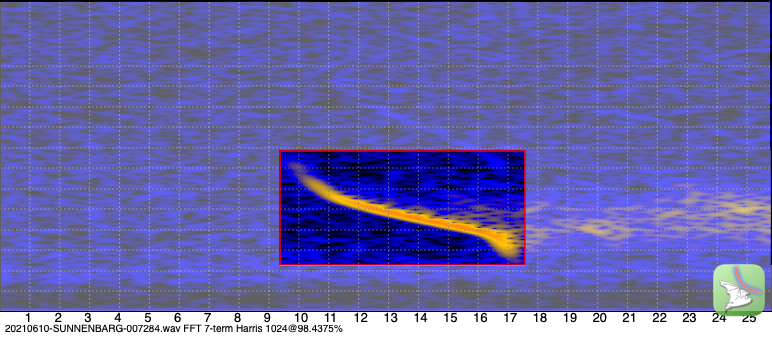

Für das Training der KI sollten Sonagramme manuell erstellt oder ausgesucht werden. Dabei lassen sich die Sonagramm-Einstellungen an den jeweiligen Ruf anpassen und solche Rufe können aussortiert werden, die durch Echos oder andere Störungen ungeeignet sind. Je besser die Trainings-Basis, desto besser wird das KI-Modell. Wir haben für diesen Schritt des Trainings verschiedene Sonagramm-Einstellungen und Bearbeitungen getestet. Angefangen haben wir mit Sonagrammen fixer Größe und einem Schwarz-Weiß Farbschema. Durch die feste Größe nimmt jedoch die Detaildarstellung kurzer Rufe ab. Der Versuch durch die Schwarz-Weiße Farbgebung Störungen zu eliminieren, hat die Modell-Qualität verbessert. Mittlerweile haben wir die fixe Größe abgeschafft, auch weil die KI-Modelle flexibler geworden sind. Zuletzt haben wir speziell für solche Aufgaben ein zeitlich hochaufgelöstes Sonagramm mit optimierter Farbpalette erstellt. Dieses wurde im Trainingsdatensatz vom Juli 2025 verwendet.

KI-Modell von 2025

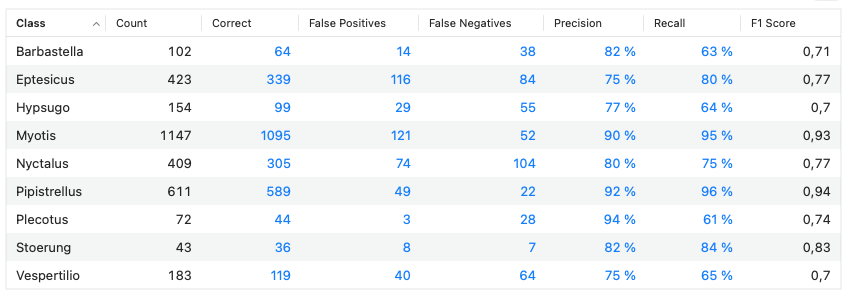

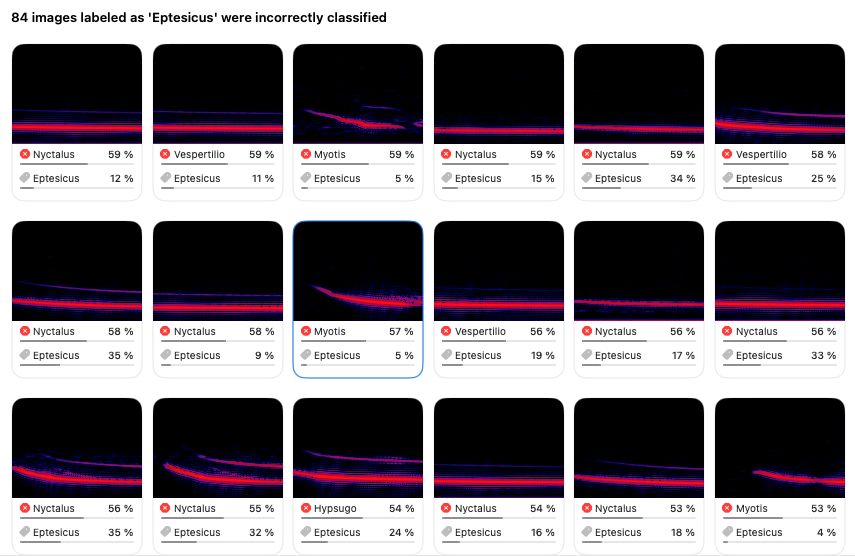

Mit der verbesserten Sonagramm-Darstellung gelingt die Trennung auf Gattungs/Gruppen-Niveau dabei mit 86% respektive 93% Genauigkeit (Apple CoreML Image Feature Print V1 vs V2). Im Training befinden sich insgesamt 591 Sonagramme aus insgesamt fünf Klassen. Das bedeutet, der Trainingsdatensatz ist eher klein, aber ausreichend für ein erstes Training. Vor allem ist ein eher kleiner Datensatz auch leichter zu erstellen. Im Zuge dessen konnten wir Mechanismen entwickeln, die die automatische Generierung basierend auf einer größeren Datenmenge ermöglichen. Erschwert man dem Modell die Klassifizierung, in dem eine Bestimmung auf Gattungsniveau trainiert wird (3144 Sonagramme aus neun Klassen), fällt die Bestimmungsqualität auf 83% im Rahmen der Validierung. Die Trainings-Genauigkeit liegt bei noch 86%. Eine Validierung mit einem losgelöstem Datensatz ergibt noch 72% korrekte Bestimmungen für die einzelnen Rufe. Die Sonagramme wurden allesamt automatisch erzeugt. Dazu wurden potenzielle Rufe innerhalb jeder Aufnahme gesucht und diese dann als Sonagramm automatisch gespeichert. Für die Erstellung wurde der Mittelwert der Bilddaten herangezogen und innerhalb eines vorher empirisch ermittelten Wertebereich platziert. Vor der Modellerstellung wurden alle Sonagramme im Überblick einer visuellen Kontrolle unterzogen und solche gelöscht, die keine Rufe oder deutliche Fehler in der Darstellung hatten. Dieses Vorgehen wurde explizit gewählt, da bei der späteren Anwendung bei großen Datenmengen ebenso automatische Mechanismen genutzt werden.

Bild-KI versus Messwert-KI

Die Bild-basierte KI mit Sonagrammen ist rechenaufwendiger als die bisher von uns verwendete Messwert-basierte KI. Die Erzeugung der Sonagramme je Ruf erfordert deutlich mehr Rechenzeit und verbraucht mehr Speicherplatz. Bereits bei gut ausgesuchten Rufen sind die Bestimmungsergebnisse leider nicht besser im Vergleich zur bisherigen KI-Methode. Bei der Anwendung mit größeren Datenmengen wird die Rufauswahl automatisch stattfinden müssen oder aber auch viele schlechte Rufe im Datensatz beinhaltet sein. Momentan können wir keine Vorteile bei der Bild-basierten KI zur Artbestimmung mit Sonagrammen erkennen. Da wir jedoch ausschliesslich die KI-Verfahren von CoreML verwenden, können wir nicht ausschließen, dass andere Verfahren besser abschneiden würden.